Obsah

Q:

Prečo sú umelé opakujúce sa neurónové siete často ťažko trénovateľné?

A:

Obtiažnosť prípravy umelých opakujúcich sa neurónových sietí súvisí s ich zložitosťou.

Jedným z najjednoduchších spôsobov, ako vysvetliť, prečo sa opakujúce sa neurónové siete ťažko trénujú, je to, že sa nejedná o priame neurónové siete.

V dopredných neurónových sieťach sa signály pohybujú iba jedným smerom. Signál sa pohybuje zo vstupnej vrstvy do rôznych skrytých vrstiev a ďalej do výstupnej vrstvy systému.

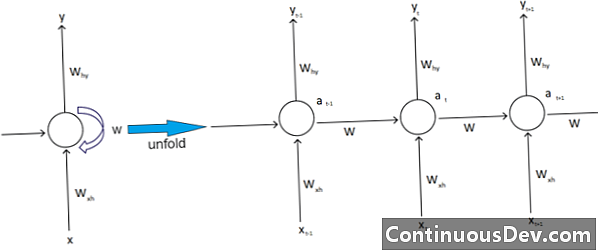

Naopak, opakujúce sa neurónové siete a iné rôzne typy neurónových sietí majú zložitejšie pohyby signálu. Rekurentné neurónové siete, klasifikované ako „spätná väzba“, môžu mať signály pohybujúce sa dopredu aj dozadu a môžu obsahovať rôzne „slučky“ v sieti, kde sa čísla alebo hodnoty vracajú späť do siete. Odborníci to spájajú s aspektom opakujúcich sa neurálnych sietí, ktoré súvisia s ich pamäťou.

Okrem toho existuje ďalší typ zložitosti ovplyvňujúci opakujúce sa neurónové siete. Jedným z vynikajúcich príkladov je oblasť spracovania prirodzeného jazyka.

Pri prepracovanom spracovaní prirodzeným jazykom musí byť neurónová sieť schopná pamätať si veci. Musí tiež brať vstupy do kon. Predpokladajme, že existuje program, ktorý chce analyzovať alebo predpovedať slovo vo vete iných slov. Systém môže mať napríklad pevnú dĺžku päť slov na vyhodnotenie. To znamená, že neurónová sieť musí mať vstupy pre každé z týchto slov, spolu so schopnosťou „pamätať si“ alebo trénovať na základe týchto slov. Z týchto a iných podobných dôvodov majú opakujúce sa neurónové siete zvyčajne tieto malé skryté slučky a odozvy v systéme.

Odborníci ľutujú, že tieto komplikácie sťažujú školenie sietí. Jedným z najbežnejších spôsobov, ako to vysvetliť, je citovanie problému explózie a miznutia gradientu. Hmotnosti siete v zásade povedú k výbuchu alebo zmiznutiu hodnôt s veľkým počtom prechodov.

Priekopník neurónovej siete Geoff Hinton vysvetľuje tento jav na webe tvrdením, že spätné lineárne priechody spôsobia, že sa menšie hmotnosti exponenciálne zmršia a explodujú väčšie hmotnosti.

Tento problém sa podľa neho zhoršuje pri dlhých sekvenciách a početnejších časových krokoch, v ktorých signály rastú alebo sa rozpadajú. Inicializácia váhy môže pomôcť, ale tieto výzvy sú zabudované do modelu opakujúcej sa neurónovej siete. Vždy bude táto otázka spojená s ich konkrétnym dizajnom a zostavením. V podstate niektoré z komplexnejších typov neurónových sietí skutočne vzdorujú našej schopnosti ľahko ich spravovať. Dokážeme vytvoriť prakticky nekonečné množstvo komplexnosti, často však vidíme, že výzvy v oblasti predvídateľnosti a škálovateľnosti narastajú.